Immagina un mondo in cui i sistemi basati sull’intelligenza artificiale (AI) non possano fare nulla di male, dove eseguano i loro compiti in modo impeccabile e senza problemi. Sembra un sogno fantascientifico, vero? Benvenuto nel mondo reale dell’intelligenza artificiale, dove le cose non sempre vanno come previsto. Una parte integrante della pratica responsabile dell’IA implica prevenire e affrontare ciò che chiamiamo “”Incidenti dell’IA.’ Questo articolo discute le competenze culturali che possono prevenire e mitigare gli incidenti legati all’IA, concentrandosi sul concetto di promozione di pratiche di intelligenza artificiale responsabili. Successivamente, esploreremo i processi aziendali correlati nei prossimi articoli per fornire una prospettiva completa su questo argomento cruciale.

Una nota sulla serie

Mentre ci imbarchiamo in questa serie, è importante fornire il contesto. Sono uno dei coautori di ‘Apprendimento automatico per applicazioni ad alto rischio,‘ insieme a Patrizio Sala E Giacomo Curtis. Questa serie è progettata per offrire un complemento conciso e di facile lettura all’ampio contenuto del libro. In ogni articolo, miriamo a distillare le intuizioni critiche, i concetti e le strategie pratiche presentate nel libro in porzioni facilmente digeribili, rendendo questa conoscenza accessibile a un pubblico più ampio.

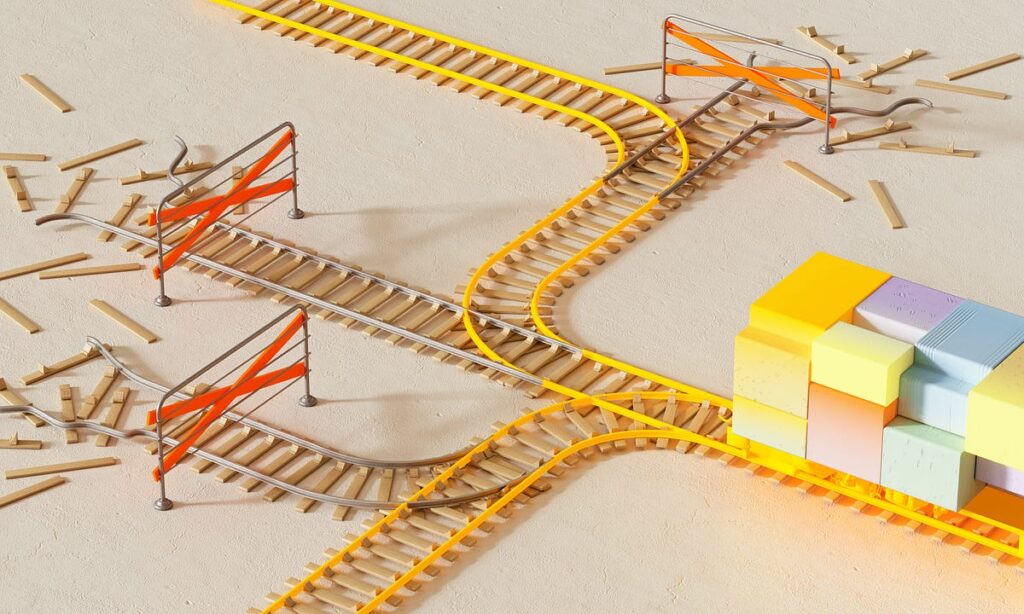

Affrontare gli incidenti legati all’intelligenza artificiale è fondamentale prima di approfondire la sicurezza del machine learning, perché non possiamo mitigare in modo efficace ciò che non comprendiamo. Gli incidenti legati all’intelligenza artificiale comprendono qualsiasi risultato derivante dai sistemi di intelligenza artificiale che potrebbe potenzialmente causare danni. La gravità di questi incidenti varia naturalmente a seconda dell’entità del danno che provocano. Questi incidenti potrebbero variare da inconvenienti relativamente minori, come robot di sicurezza del centro commerciale che cadono dalle scalea eventi più catastrofici, come le auto a guida autonoma causano la morte dei pedoni e il dirottamento su larga scala delle risorse sanitarie lontano da coloro che ne hanno disperato bisogno.

Gli incidenti legati all’intelligenza artificiale comprendono qualsiasi risultato derivante dai sistemi di intelligenza artificiale che potrebbe potenzialmente causare danni.

Possiamo classificare gli incidenti legati all’IA in tre gruppi principali:

Fonte: towardsdatascience.com