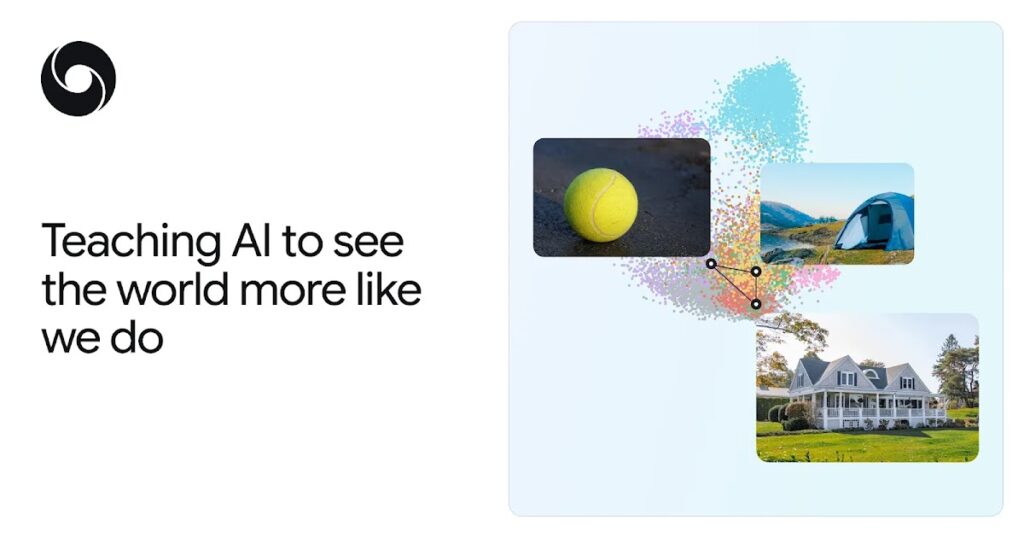

Una nuova ricerca mostra che la riorganizzazione delle rappresentazioni visive di un modello può renderlo più utile, robusto e affidabile

L’intelligenza artificiale “visiva” (AI) è ovunque. Lo usiamo per ordinare le nostre foto, identificare fiori sconosciuti e guidare le nostre auto. Ma questi potenti sistemi non sempre “vedono” il mondo come lo vediamo noi, e talvolta si comportano in modi sorprendenti. Ad esempio, un sistema di intelligenza artificiale in grado di identificare centinaia di produttori e modelli di automobili potrebbe non riuscire a catturare gli aspetti comuni tra un’auto e un aereo. cioè entrambi sono veicoli di grandi dimensioni realizzati principalmente in metallo.

Per comprendere meglio queste differenze, oggi pubblichiamo un nuovo articolo su Nature analizzando i modi importanti in cui i sistemi di intelligenza artificiale organizzano il mondo visivo in modo diverso dagli esseri umani. Presentiamo un metodo per allineare meglio questi sistemi con la conoscenza umana e mostriamo che affrontare queste discrepanze migliora la loro robustezza e capacità di generalizzare.

Questo lavoro è un passo avanti verso la costruzione di sistemi di intelligenza artificiale più intuitivi e affidabili.

Perché l’intelligenza artificiale lotta con “quello strano”

Quando vedi un gatto, il tuo cervello crea una rappresentazione mentale che cattura tutto ciò che riguarda il gatto, dai concetti di base come il suo colore e la pelosità a concetti di alto livello come la sua “gattilità”. I modelli di visione basati sull’intelligenza artificiale producono anche rappresentazioni, mappando le immagini in punti in uno spazio ad alta dimensione in cui oggetti simili (come due pecore) sono posizionati vicini e oggetti diversi (una pecora e una torta) sono distanti.

Per comprendere le differenze nel modo in cui sono organizzate le rappresentazioni umane e quelle dei modelli, abbiamo utilizzato il classico compito delle scienze cognitive, chiedendo sia agli esseri umani che ai modelli di scegliere quale delle tre immagini fornite non si adatta alle altre. Questo test rivela quali due elementi “vedono” come più simili.

A volte, tutti sono d’accordo. Dato un tapiro, una pecora e una torta di compleanno, sia gli umani che i modelli scelgono in modo affidabile la torta come quella strana. Altre volte, la risposta giusta non è chiara e le persone e i modelli non sono d’accordo.

È interessante notare che abbiamo anche riscontrato molti casi in cui gli esseri umani sono fortemente d’accordo su una risposta, ma i modelli di intelligenza artificiale la sbagliano. Per quanto riguarda il terzo esempio riportato di seguito, la maggior parte delle persone concorda che la stella marina è quella strana. Ma la maggior parte dei modelli visivi si concentra maggiormente su caratteristiche superficiali come il colore e la trama dello sfondo e scelgono invece il gatto.

Fonte: deepmind.google