Prove citate in un eBook intitolato “AI Quantum Resilience”, pubblicato da Utimaco (email wall), mostra che le organizzazioni considerano i rischi per la sicurezza come il principale ostacolo all’adozione efficace dell’intelligenza artificiale sui dati in loro possesso.

Il valore dell’intelligenza artificiale dipende dai dati accumulati da un’organizzazione. Tuttavia, esistono rischi per la sicurezza nella creazione di modelli e nel loro addestramento su tali dati. Questi rischi si aggiungono alle minacce alla proprietà intellettuale meglio pubblicizzate che esistono attorno al punto di deduzione (ad esempio il prompt engineering).

Gli autori dell’eBook affermano che le organizzazioni devono gestire le minacce durante tutti i processi di sviluppo e implementazione dell’intelligenza artificiale. Allo stesso tempo, le aziende possono e devono prepararsi a modificare i propri protocolli di sicurezza, modifiche che diventeranno obbligatorie se gli strumenti di decrittazione basati sull’informatica quantistica diventeranno facilmente disponibili per i malintenzionati.

Utimaco elenca tre aree minacciate:

- I dati di addestramento possono essere manipolati da malintenzionati, degradando i risultati del modello in modi difficili da rilevare,

- I modelli possono essere estratti o copiati, erodendo i diritti di proprietà intellettuale,

- I dati sensibili utilizzati durante l’addestramento o l’inferenza possono essere esposti.

L’attuale crittografia a chiave pubblica diventerà vulnerabile nei prossimi dieci anni, attestano gli autori del rapporto; un periodo in cui potrebbero emergere sistemi quantistici capaci. Indipendentemente dai tempi, si ritiene che gruppi meglio organizzati attualmente raccolgano dati crittografati e li archivino per decrittografarli quando o se le strutture quantistiche saranno disponibili. Pertanto, qualsiasi set di dati con sensibilità a lungo termine, inclusi dati di addestramento del modello, documenti finanziari o proprietà intellettuale, potrebbe richiedere protezione contro la futura decrittazione, afferma Utimaco.

Una migrazione alla crittografia resistente ai quanti influenzerà i protocolli, la gestione delle chiavi, l’interoperabilità del sistema e le prestazioni, quindi è probabile che qualsiasi migrazione richieda diversi anni. Gli autori del rapporto suggeriscono quella che chiamano “cripto-agilità”, che definisce come la modifica degli algoritmi crittografici senza riprogettare i sistemi sottostanti. La “cripto-agilità” si basa sul principio della crittografia ibrida, combinando algoritmi consolidati con metodi post-quantistici, come quelli suggeriti dal NIST.

Gli autori dell’eBook concordano sul fatto che la crittografia da sola non affronta tutte le possibili aree di rischio. Sostiene l’uso di dispositivi di fiducia basati su hardware in grado di isolare le chiavi crittografiche e le operazioni sensibili dai normali ambienti di lavoro.

Se le aziende stanno sviluppando i propri strumenti e processi di intelligenza artificiale, la protezione su tale base dovrebbe estendersi a tutto il ciclo di vita dell’intelligenza artificiale, dall’acquisizione dei dati fino alla formazione, all’implementazione del modello e all’inferenza nella produzione. Le chiavi hardware utilizzate per crittografare i dati e firmare i modelli possono essere generate e archiviate all’interno di un confine. L’integrità del modello può quindi essere verificata prima della distribuzione e i dati sensibili elaborati durante l’inferenza rimangono protetti.

Le enclavi basate su hardware isolano i carichi di lavoro in modo che anche gli amministratori di sistema con privilegi sufficienti non possano accedere ai dati in fase di elaborazione. I moduli hardware possono verificare che l’enclave dei dati sia in uno stato affidabile prima di rilasciare le chiavi (un processo di attestazione esterna) contribuendo a creare una “catena di fiducia” dall’hardware all’applicazione.

La gestione delle chiavi basata su hardware produce registri a prova di manomissione che coprono gli accessi e le operazioni per supportare quadri di conformità come la legge sull’intelligenza artificiale dell’UE.

Molti dei rischi inerenti ai sistemi di intelligenza artificiale sono ben noti se non già sfruttati. Il rischio derivante dalla capacità dell’informatica quantistica di decrittografare i dati attualmente considerati sicuri è meno immediato, ma le implicazioni dovrebbero influenzare le decisioni sui dati e sulle infrastrutture prese oggi, afferma Utimaco. Esso sostiene:

- Un rafforzamento dei controlli durante tutto il ciclo di vita dello sviluppo e della distribuzione dell’IA,

- L’introduzione della “cripto-agilità” per consentire la transizione verso la sicurezza post-quantistica,

- Stabilire meccanismi di fiducia basati sull’hardware ovunque siano in gioco risorse di alto valore.

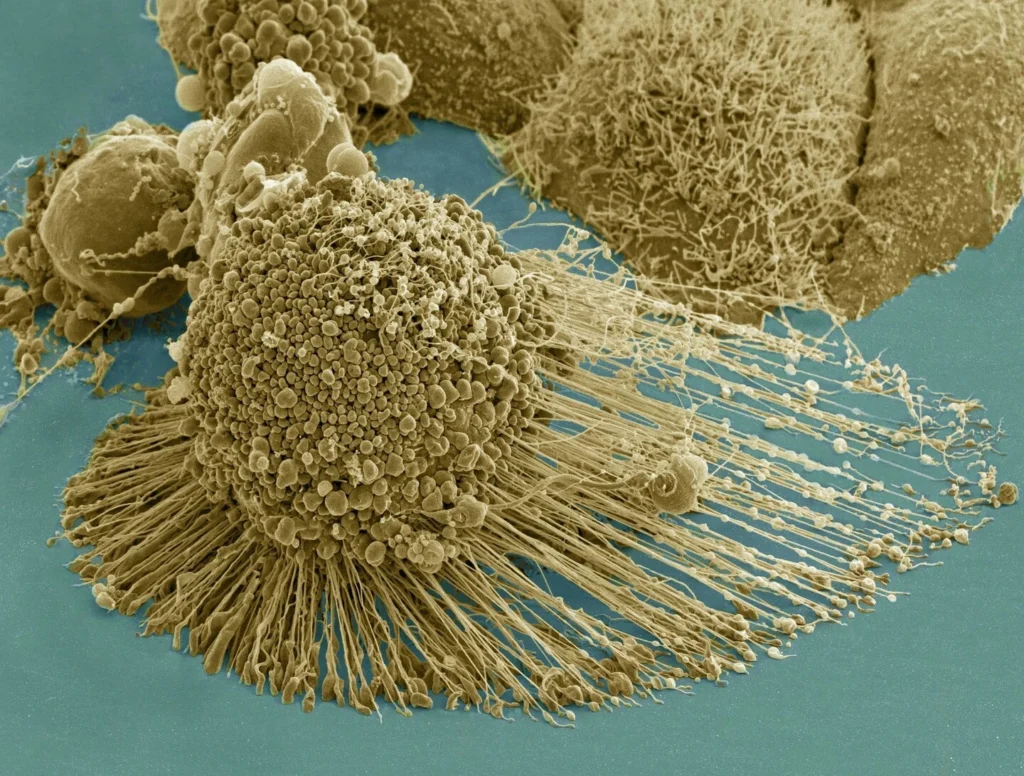

(Fonte immagine: “Micrografia elettronica a scansione di una cellula HeLa apoptotica” del National Institutes of Health (NIH) è concessa in licenza con CC BY-NC 2.0. Per visualizzare una copia di questa licenza, visitare https://creativecommons.org/licenses/by-nc/2.0)

Vuoi saperne di più sull’intelligenza artificiale e sui big data dai leader del settore? Guardare Fiera dell’intelligenza artificiale e dei big data che si svolge ad Amsterdam, in California, e a Londra. L’evento completo è parte di TechEx e co-localizzato con altri importanti eventi tecnologici. Clic Qui per ulteriori informazioni

AI News è alimentato da Media TechForge. Esplora altri prossimi eventi e webinar sulla tecnologia aziendale Qui.

Fonte: www.artificialintelligence-news.com