Il gruppo di formiche si basa sui semiconduttori di fabbricazione cinese per formare modelli di intelligenza artificiale per ridurre i costi e ridurre la dipendenza dalla tecnologia statunitense limitata, secondo le persone che hanno familiarità con la questione.

La società di proprietà di Alibaba ha utilizzato chip da fornitori domestici, compresi quelli legati al suo genitore, Alibabae tecnologie Huawei per formare modelli di grandi dimensioni utilizzando il metodo della miscela di esperti (MOE). Secondo quanto riferito, i risultati sono stati paragonabili a quelli prodotti con i chip H800 di Nvidia, sostengono fonti. Mentre Ant continua a utilizzare i chip Nvidia per alcuni dei suoi sviluppi di intelligenza artificiale, una fonte ha affermato che la società si sta trasformando sempre più in alternative da AMD e produttori di chip cinesi per i suoi ultimi modelli.

Lo sviluppo segnala un coinvolgimento più profondo di Ant nella crescente razza di intelligenza artificiale tra aziende tecnologiche cinesi e statunitensi, in particolare quando le aziende cercano modi economici per formare modelli. La sperimentazione con hardware domestico riflette uno sforzo più ampio tra le aziende cinesi per aggirare le restrizioni di esportazione che bloccano l'accesso a chip di fascia alta come l'H800 di Nvidia, che, sebbene non i più avanzati, è ancora una delle GPU più potenti disponibili per le organizzazioni cinesi.

Ant ha pubblicato un documento di ricerca che descrive il suo lavoro, affermando che i suoi modelli, in alcuni test, hanno funzionato meglio di quelli sviluppati da Meta. Bloomberg Newsche inizialmente ha riferito la questione, non ha verificato i risultati della società in modo indipendente. Se i modelli si esibiscono come sostenuto, gli sforzi di Ant possono rappresentare un passo avanti nel tentativo della Cina di ridurre i costi di gestione delle applicazioni di intelligenza artificiale e ridurre la dipendenza dall'hardware straniero.

I modelli MOE dividono le attività in set di dati più piccoli gestiti da componenti separati e hanno attirato l'attenzione tra ricercatori di intelligenza artificiale e data scientist. La tecnica è stata utilizzata da Google e dalla startup con sede a Hangzhou, DeepSeek. Il concetto MOE è simile ad avere un team di specialisti, ognuno maneggiando parte di un compito per rendere più efficiente il processo di produzione dei modelli. Ant ha rifiutato di commentare il suo lavoro rispetto alle sue fonti hardware.

La formazione dei modelli MOE dipende da GPU ad alte prestazioni che possono essere troppo costose per l'acquisizione o l'utilizzo delle aziende più piccole. La ricerca di Ant si è concentrata sulla riduzione di tale barriera. Il titolo del documento è sufficiente con un chiaro obiettivo: ridimensionamento dei modelli “senza GPU premium”. (le nostre virgolette)

La direzione presa da ANT e l'uso di MOE per ridurre il contrasto dei costi di allenamento con l'approccio di Nvidia. L'agente CEO Jensen Huang ha affermato che la domanda di potenza informatica continuerà a crescere, anche con l'introduzione di modelli più efficienti come la R1 di Deepseek. Il suo punto di vista è che le aziende cercheranno chip più potenti per guidare la crescita dei ricavi, piuttosto che mirare a ridurre i costi con alternative più economiche. La strategia di Nvidia rimane concentrata sulla costruzione di GPU con più core, transistor e memoria.

Secondo il documento del gruppo Ant, addestramento a un trilione di token-le unità di base dei modelli di AI di dati utilizzano per apprendere-costano circa 6,35 milioni di yuan (circa $ 880.000) utilizzando hardware convenzionale ad alte prestazioni. Il metodo di allenamento ottimizzato dell'azienda ha ridotto tale costo a circa 5,1 milioni di yuan utilizzando chip a bassa specifica.

Ant ha dichiarato di voler applicare i suoi modelli prodotti in questo modo-Ling-Plus e Ling-Lite-a casi di utilizzo dell'intelligenza artificiale industriali come l'assistenza sanitaria e la finanza. All'inizio di quest'anno, la società ha acquisito Haodf.com, una piattaforma medica online cinese, per ulteriori ambizioni di Ant di distribuire soluzioni basate sull'intelligenza artificiale in sanità. Gestisce inoltre altri servizi di intelligenza artificiale, tra cui un'app di assistente virtuale chiamata Zhixiaobao e una piattaforma di consulenza finanziaria nota come Maxiaocai.

“Se trovi un punto di attacco per battere il meglio del mondo Kung Fu Maestro, puoi ancora dire che li hai battuti, motivo per cui è importante l'applicazione del mondo reale “, ha affermato Robin Yu, Chief Technology Officer della società AI con sede a Beijing, Shengshang Tech.

Ant ha reso i suoi modelli open source. Ling-Lite ha 16,8 miliardi di parametri-impostazioni che aiutano a determinare come funziona un modello-mentre Ling-plus ha 290 miliardi. Per un confronto, le stime suggeriscono che GPT-4.5 a sorta chiusa ha circa 1,8 trilioni di parametri, secondo Revisione della tecnologia del MIT.

Nonostante i progressi, l'articolo di Ant ha notato che i modelli di formazione rimane impegnativi. Piccoli aggiustamenti all'hardware o alla struttura del modello durante l'allenamento del modello a volte hanno comportato prestazioni instabili, compresi i picchi nei tassi di errore.

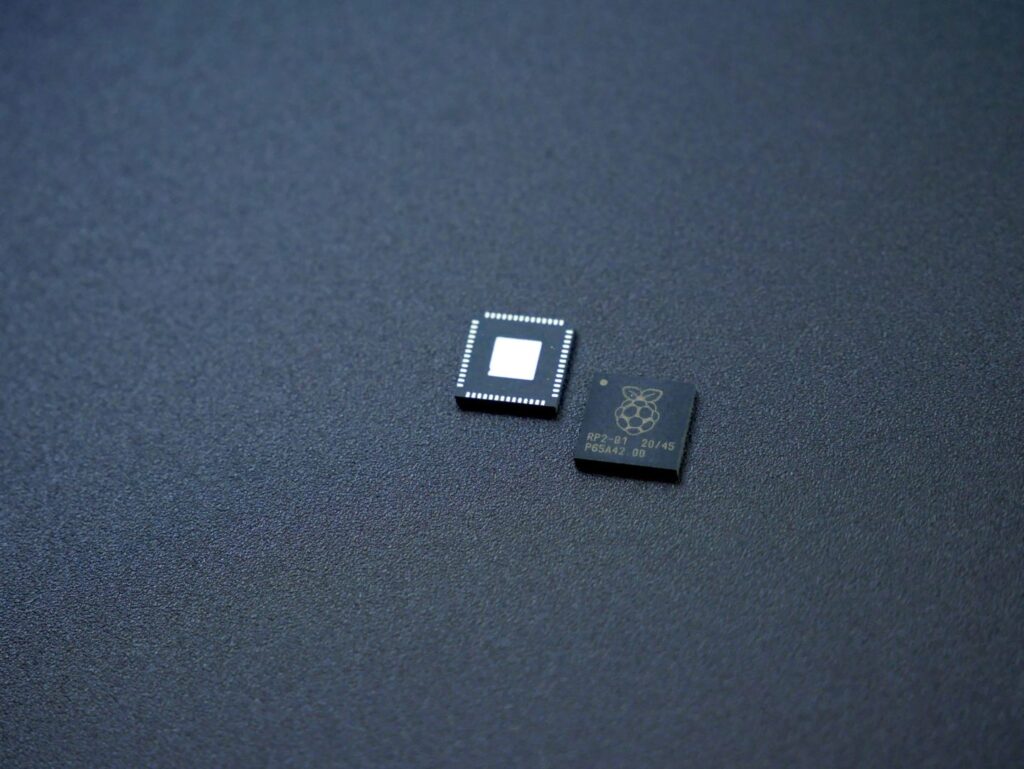

(Foto di Non esplodente)

Vedi anche: DeepSeek V3-0324 TOP Modelli di AI non ragionato in open source prima

Vuoi saperne di più sull'intelligenza artificiale e sui big da parte dei leader del settore? Guardare AI e Big Data Expo si svolge ad Amsterdam, in California e a Londra. L'evento completo è co-localizzato con altri eventi principali tra cui Conferenza di automazione intelligente, Blockx, Settimana di trasformazione digitaleE Cyber Security & Cloud Expo.

Esplora altri prossimi eventi tecnologici aziendali e webinar alimentati da TechForge Qui.

Fonte: www.artificialintelligence-news.com