I modelli OpenAI si sono evoluti drasticamente negli ultimi anni. Il viaggio è iniziato con GPT-3.5 e ora ha raggiunto GPT-5.1 e i nuovi modelli di ragionamento della serie o. Sebbene ChatGPT utilizzi GPT-5.1 come modello principale, l’API ti dà accesso a molte più opzioni progettate per diversi tipi di attività. Alcuni modelli sono ottimizzati per velocità e costi, altri sono progettati per un ragionamento approfondito e alcuni sono specializzati in immagini o audio.

In questo articolo ti guiderò attraverso tutti i principali modelli disponibili tramite l’API. Imparerai per cosa è più adatto ogni modello, a quale tipo di progetto si adatta e come lavorarci utilizzando semplici esempi di codice. L’obiettivo è darti una chiara comprensione di quando scegliere un particolare modello e come utilizzarlo in modo efficace in un’applicazione reale.

GPT-3.5 Turbo: le basi dell’intelligenza artificiale moderna

IL GPT-3.5 Turbo ha avviato la rivoluzione dell’intelligenza artificiale generativa. IL ChatGPT può anche alimentare l’originale ed è anche una soluzione stabile ed economica a basso costo per compiti semplici. Il modello si limita a obbedire alle indicazioni e condurre una conversazione. Ha la capacità di rispondere a domande, riassumere testo e scrivere codice semplice. I modelli più recenti sono più intelligenti, ma GPT-3.5 Turbo può ancora essere applicato ad attività ad alto volume in cui il costo è la considerazione principale.

Caratteristiche principali:

- Velocità e costi: È molto veloce e molto economico.

- Azione dopo l’istruzione: È anche un successore affidabile di semplici istruzioni.

- Contesto: Giustifica la finestra token 4K (circa 3.000 parole).

Esempio pratico:

Quello che segue è un breve Pitone script per utilizzare GPT-3.5 Turbo per il riepilogo del testo.

import openai

from google.colab import userdata

# Set your API key

client = openai.OpenAI(api_key=userdata.get('OPENAI_KEY'))

messages = (

{"role": "system", "content": "You are a helpful summarization assistant."},

{"role": "user", "content": "Summarize this: OpenAI changed the tech world with GPT-3.5 in 2022."}

)

response = client.chat.completions.create(

model="gpt-3.5-turbo",

messages=messages

)

print(response.choices(0).message.content)Produzione:

Famiglia GPT-4: centrali multimodali

IL GPT-4 la famiglia è stata una svolta enorme. Tali serie sono GPT-4, GPT-4 Turbo e l’efficientissimo GPT-4o. Questi modelli sono multimodali, ovvero in grado di comprendere sia testo che immagini. La loro forza principale risiede nel pensiero complicato, nella ricerca legale e nella scrittura creativa sottile.

Caratteristiche GPT-4o:

- Ingresso multimodale: Gestisce testi e immagini contemporaneamente.

- Velocità: GPT-4o (o è Omni) è due volte più veloce di GPT-4.

- Prezzo: È molto meno costoso del tradizionale modello GPT-4.

Uno studio openAI ha rivelato che GPT-4 ha ottenuto un test a barra simulato nel 10% dei migliori individui che hanno sostenuto il test. Ciò è un’indicazione della sua capacità di gestire una logica sofisticata.

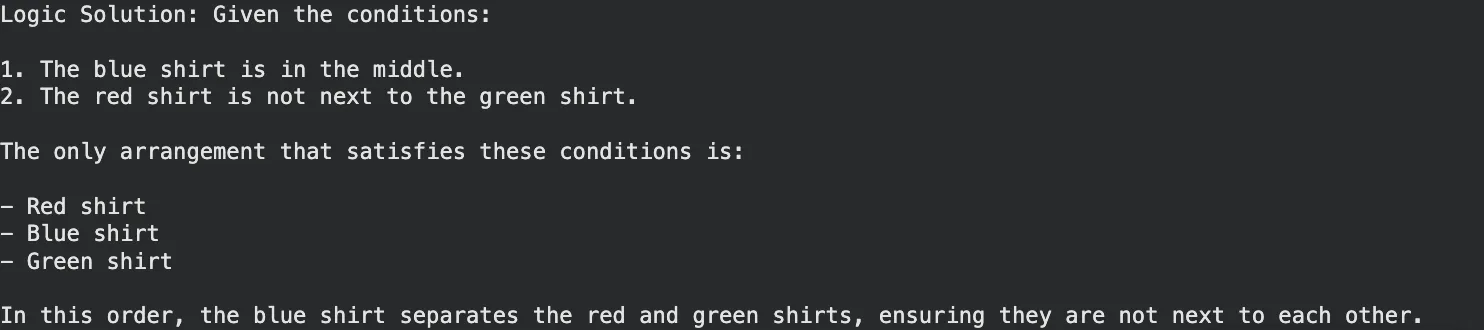

Esempio pratico (logica complessa):

GPT-4o ha la capacità di risolvere un puzzle logico che coinvolge il ragionamento.

messages = (

{"role": "user", "content": "I have 3 shirts. One is red, one blue, one green. "

"The red is not next to the green. The blue is in the middle. "

"What is the order?"}

)

response = client.chat.completions.create(

model="gpt-4o",

messages=messages

)

print("Logic Solution:", response.choices(0).message.content)Produzione:

La Serie O: modelli che pensano prima di parlare

Tra la fine del 2024 e l’inizio del 2025 OpenAI ha annunciato la serie o (o1, o1-mini e o3-mini). Questi sono “modelli di ragionamento”. Non rispondono immediatamente ma si prendono del tempo per pensare e ideare una strategia diversa dai normali modelli GPT. Ciò rende loro superiori la matematica, la scienza e la codifica difficile.

Caratteristiche principali di o1 e o3-mini:

- Catena di pensiero: Questo modello controlla internamente i propri passaggi riducendo al minimo gli errori.

- Abilità di codifica: o3-mini è progettato per essere veloce e preciso nei codici.

- Efficienza: o3-mini è un modello altamente intelligente ad un prezzo più economico rispetto al modello o1 completo.

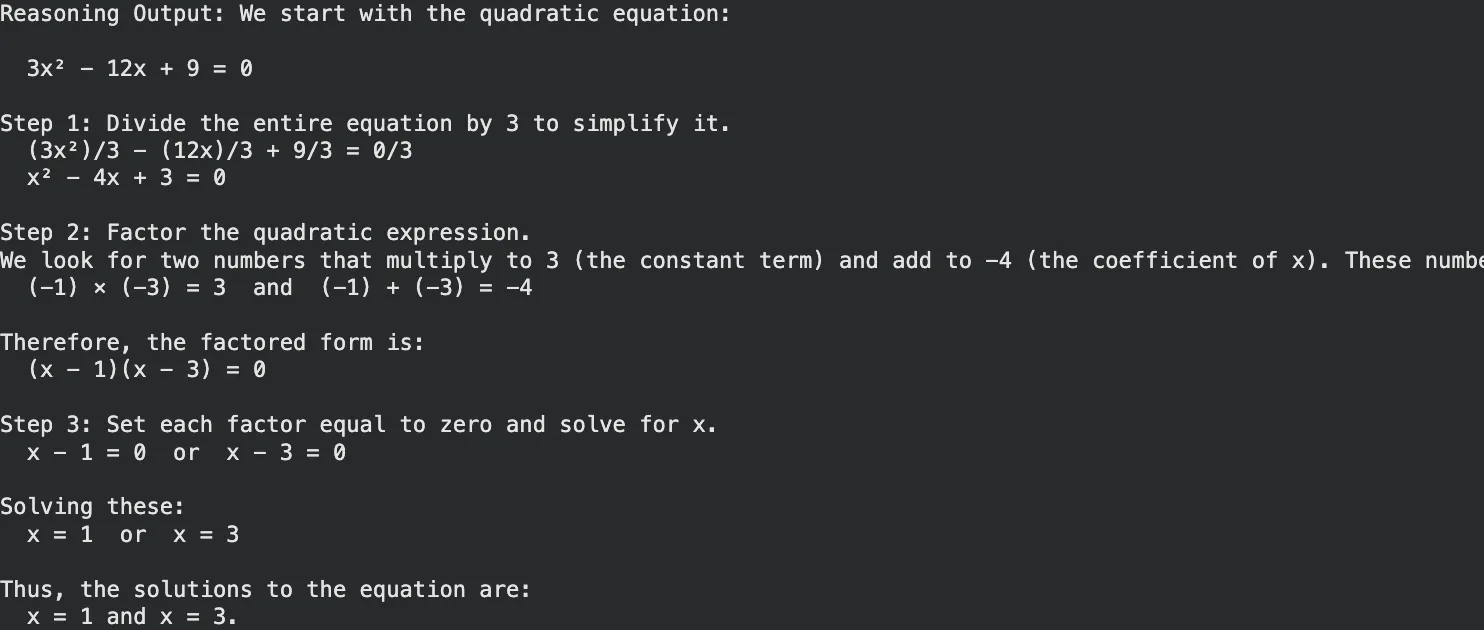

Esempio pratico (ragionamento matematico):

Utilizza o3-mini per un problema di matematica in cui la verifica passo passo è fondamentale.

# Using the o3-mini reasoning model

response = client.chat.completions.create(

model="o3-mini",

messages=({"role": "user", "content": "Solve for x: 3x^2 - 12x + 9 = 0. Explain steps."})

)

print("Reasoning Output:", response.choices(0).message.content)Produzione:

GPT-5 e GPT-5.1: la prossima generazione

Entrambi GPT-5 e la sua versione ottimizzata GPT-5.1che è stato rilasciato a metà del 2025, combinava ritmo e logica. GPT-5 fornisce un pensiero integrato, in cui il modello stesso determina quando pensare e quando rispondere in breve tempo. La versione, GPT-5.1, è stata perfezionata per avere controlli aziendali superiori e meno allucinazioni.

Cosa li distingue:

- Pensiero adattivo: Richiede domande semplici fino a percorsi semplici e ragionamenti semplici fino a percorsi di ragionamento difficili.

- Grado aziendale: GPT-5.1 ha la possibilità di ricerca approfondita con funzionalità Pro.

- L’immagine GPT 1: Questo è un menu integrato che sostituisce DA-E 3 per fornire una creazione fluida di immagini in chat.

Esempio pratico (strategia aziendale):

GPT-5.1 è molto buono per la strategia di alto livello che coinvolge conoscenze generali e pensiero strutturato.

# Example using GPT-5.1 for strategic planning

response = client.chat.completions.create(

model="gpt-5.1",

messages=({"role": "user", "content": "Draft a go-to-market strategy for a new AI coffee machine."})

)

print("Strategy Draft:", response.choices(0).message.content)Produzione:

DALL-E 3 e Immagine GPT: creatività visiva

Nel caso dei dati visivi, OpenAI fornisce DALL-E 3 e i più recenti modelli GPT Image. Queste applicazioni trasformeranno i suggerimenti testuali in bellissime immagini approfondite. Lavorare con DALL-E 3 ti consentirà di disegnare immagini, loghi e schemi semplicemente descrivendoli.

Per saperne di più: Generazione di immagini utilizzando l’API GPT Image

Capacità chiave:

- Azione immediata: Osserva rigorosamente le istruzioni elaborate.

- Integrazione: È integrato in ChatGPT e nell’API.

Esempio pratico (generazione di immagini):

Questo script genera un URL di immagine in base al messaggio di testo.

image_response = client.images.generate(

model="dall-e-3",

prompt="A futuristic city with flying cars in a cyberpunk style",

n=1,

size="1024x1024"

)

print("Image URL:", image_response.data(0).url)Produzione:

Sussurro: padronanza della sintesi vocale

Whisper Il sistema di riconoscimento vocale è lo stato dell’arte fornito da OpenAI. Ha la capacità di trascrivere l’audio di dozzine di lingue in inglese. È resistente al rumore di fondo e agli accenti. Il seguente frammento del tutorial sull’API Whisper è un’indicazione di quanto sia semplice da utilizzare.

Esempio pratico (trascrizione):

Assicurati di essere in una directory con un file audio (chiamato speak.mp3).

audio_file = open("speech.mp3", "rb")

transcript = client.audio.transcriptions.create(

model="whisper-1",

file=audio_file

)

print("Transcription:", transcript.text)Produzione:

Incorporamenti e moderazione: gli strumenti di utilità

OpenAI ha modelli di utilità fondamentali per gli sviluppatori.

- Incorporamenti (text-embedding-3-small/large): Questi vengono utilizzati per codificare il testo come numeri (vettori). Ciò ti consente di creare motori di ricerca in grado di decifrare il significato anziché le parole chiave.

- Moderazione: Si tratta di un’API gratuita che verifica il contenuto testuale di incitamento all’odio, violenza o autolesionismo per garantire la sicurezza delle app.

Esempio pratico (ricerca semantica):

Questo scopre il fatto che esiste una somiglianza tra una query e un prodotto.

# Get embeddings

resp = client.embeddings.create(

input=("smartphone", "banana"),

model="text-embedding-3-small"

)

# In a real app, you compare these vectors to find the best match

print("Vector created with dimension:", len(resp.data(0).embedding))Produzione:

Messa a punto: personalizzare la tua intelligenza artificiale

L’ottimizzazione consente l’addestramento di un modello utilizzando i propri dati. GPT-4o-mini o GPT-3.5 possono essere perfezionati per acquisire un tono, un formato o un gergo del settore particolari. Ciò è potente nel caso delle applicazioni aziendali, che richiedono solo una risposta generale.

Come funziona:

- Preparare un file JSON con esempi di formazione.

- Carica il file su OpenAI.

- Inizia un lavoro di messa a punto.

- Utilizza il tuo nuovo ID modello personalizzato nell’API.

Conclusione

Il panorama del modello OpenAI offre uno strumento per quasi ogni attività digitale. Dalla velocità di GPT-3.5 Turbo alla potenza di ragionamento di o3-mini e GPT-5.1, gli sviluppatori hanno vaste opzioni. Puoi creare applicazioni vocali con Whisper, creare risorse visive con DALL-E 3 o analizzare dati con i modelli di ragionamento più recenti.

Le barriere all’ingresso rimangono basse. Hai semplicemente bisogno di una chiave API e di un concetto. Ti invitiamo a testare gli script forniti in questa guida. Sperimenta i diversi modelli per comprenderne i punti di forza. Trova il giusto equilibrio tra costo, velocità e intelligenza per le tue esigenze specifiche. Esiste la tecnologia per alimentare la tua prossima applicazione. Ora tocca a te applicarlo.

Domande frequenti

R. GPT-4o è un modello multimodale generico ideale per la maggior parte delle attività. o3-mini è un modello di ragionamento ottimizzato per problemi complessi di matematica, scienze e codifica.

R. No, DALL-E 3 è un modello a pagamento con prezzo per immagine generata. I costi variano in base alla risoluzione e alle impostazioni di qualità.

R. Sì, il modello Whisper è open source. Puoi eseguirlo sul tuo hardware senza pagare tariffe API, a condizione che tu abbia una GPU.

R. GPT-5.1 supporta un’enorme finestra di contesto (spesso 128.000 token o più), consentendogli di elaborare interi libri o lunghe basi di codice in una volta sola.

R. Questi modelli sono disponibili per gli sviluppatori tramite l’API OpenAI e per gli utenti tramite abbonamenti ChatGPT Plus, Team o Enterprise.

Accedi per continuare a leggere e goderti i contenuti curati dagli esperti.

Fonte: www.analyticsvidhya.com