1. Personalizzazione della ricetta

La personalizzazione delle ricette è fondamentale a causa della connessione tra cibo, abitudini e preferenze individuali. Inoltre, diventa essenziale quando si affrontano allergie o restrizioni dietetiche. Sorprendentemente, nonostante l’evidente domanda, la letteratura esistente manca di sforzi dedicati alla personalizzazione delle ricette. Il nostro lavoro mira a colmare il divario della ricerca consentendo la personalizzazione delle ricette personalizzate, considerando i profili di gusto individuali e le restrizioni dietetiche.

Per guidare la ricerca futura in quest’area, mostriamo la capacità di FIRE di supportare un approccio di personalizzazione delle ricette che si concentra su un’ampia gamma di argomenti (ad esempio, sostituzione degli ingredienti, aggiustamento del gusto, aggiustamento delle calorie, adattamento del tempo di cottura) per testare le prestazioni con pochi colpi. completamente. Come mostrato nella parte viola della Figura 5, rimuoviamo gli ingredienti per tagliare le patate dalla ricetta. Nella versione modificata due frasi relative alle patate sono state cancellate e una frase è stata modificata per garantire coerenza. Nello specifico, eseguiamo l’aggiunta degli ingredienti da sostituire’formaggio‘ con ‘formaggio cheddar‘ e riconosco che dovrebbe essere aggiunto prima della cottura, con conseguente frase modificata ‘Cospargere metà ciascuno di formaggio cheddar e cipolle.’

2. Generazione di codice macchina per ricette basate su immagini

La conversione delle ricette in codice macchina consente l’automazione, la scalabilità e l’integrazione con vari sistemi esistenti, riducendo così l’intervento manuale, risparmiando sui costi di manodopera e riducendo gli errori umani durante la preparazione del cibo. Per facilitare questo compito, combiniamo la forza della generazione di ricette di FIRE con la capacità dei grandi LM di manipolare prompt in stile codice per compiti strutturali (14). Mostriamo un approccio di esempio per generare rappresentazioni di codice in stile Python di ricette sviluppate da FIRE, richiedendo GPT-3 (fare riferimento alla parte arancione nella Figura 5).

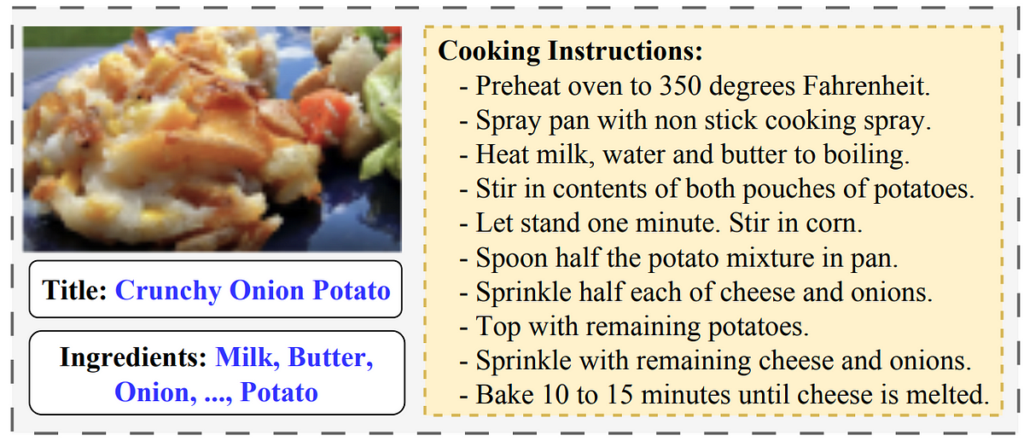

Abbiamo introdotto FIRE, una metodologia su misura per il food computing, focalizzata sulla generazione di titoli di cibo, sull’estrazione di ingredienti e sulla generazione di istruzioni di cottura esclusivamente da input di immagini. Abbiamo sfruttato i recenti progressi nella modellazione del CV e del linguaggio per ottenere prestazioni superiori rispetto a solide linee di base. Inoltre, abbiamo dimostrato le applicazioni pratiche di FIRE per personalizzazione della ricetta E generazione da ricetta a codicedimostrando l’adattabilità e il potenziale di automazione del nostro approccio.

Elenchiamo tre sfide che dovrebbero essere affrontate nella ricerca futura:

- I modelli di generazione di ricette esistenti e proposti non dispongono di un meccanismo affidabile per verificare l’accuratezza delle ricette generate. I parametri di valutazione convenzionali non sono all’altezza sotto questo aspetto. Pertanto, vorremmo creare una nuova metrica che valuti la coerenza e la plausibilità delle ricette, fornendo una valutazione più approfondita.

- La diversità e la disponibilità delle ricette sono influenzate da fattori geografici, climatici e religiosi, che possono limitarne l’applicabilità. Incorporare grafici della conoscenza che tengano conto di questi fattori contestuali e delle relazioni tra gli ingredienti può offrire suggerimenti alternativi sugli ingredienti, affrontando questo problema.

- Le allucinazioni nella generazione di ricette utilizzando modelli linguistici e visivi rappresentano una sfida significativa. Il lavoro futuro esplorerà i metodi di monitoraggio dello stato per migliorare il processo di generazione, garantendo la produzione di ricette più realistiche e accurate.

Spero che questa panoramica ti abbia fornito informazioni sull’ispirazione e sullo sviluppo di FIRE, il nostro strumento innovativo per convertire immagini di cibo in ricette dettagliate. Per un’esplorazione più approfondita del nostro approccio, ti invito a consultare il nostro articolo completo, pubblicato nel Conferenza invernale IEEE/CVF sulle applicazioni della visione artificiale (WACV) – 2024. Se la nostra ricerca contribuisce al tuo lavoro, saremmo felici se la citassi. 😊

Collegamento cartaceo: https://openaccess.thecvf.com/content/WACV2024/html/Chhikara_FIRE_Food_Image_to_REcipe_Generation_WACV_2024_paper.html

@InProceedings{Chhikara_2024_WACV,

author = {Chhikara, Prateek and Chaurasia, Dhiraj and Jiang, Yifan and Masur, Omkar and Ilievski, Filip},

title = {FIRE: Food Image to REcipe Generation},

booktitle = {Proceedings of the IEEE/CVF Winter Conference on Applications of Computer Vision (WACV)},

month = {January},

year = {2024},

pages = {8184-8194}

}

(1) Weiqing Min, Shuqiang Jiang, Linhu Liu, Yong Rui e Ramesh Jain. Un’indagine sul food computing. Calcolo ACM. Surv., 52(5), settembre 2019.

(2) Salute Sutter. Mangiare bene per la salute mentale. https://www.sutterhealth.org/health/nutrition/eating-wellfor-mental-health. Accesso effettuato il 24 marzo 2023.

(3) Kiely Kuligowski. 12 motivi per utilizzare Instagram per il tuo business. https://www.business.com/articles/10-reasons-touse-instagram-for-business/. Accesso effettuato il 12 maggio 2023.

(4) Dim P. Papadopoulos, Enrique Mora, Nadia Chepurko, Kuan Wei Huang, Ferda Ofli e Antonio Torralba. Rappresentazioni del programma di apprendimento per immagini di cibo e ricette di cucina,

(5) Sundaram Gunasekaran. Tecnologia di visione artificiale per la garanzia della qualità degli alimenti. Tendenze nella scienza e tecnologia alimentare, 7(8):245–256, 1996.

(6) Yoshiyuki Kawano e Keiji Yanai. Riconoscimento di immagini di alimenti con profonde caratteristiche convoluzionali. In Atti della conferenza congiunta internazionale ACM del 2014 sul Pervasive and Ubiquitous Computing: pubblicazione aggiuntiva, pagine 589–593, 2014

(7) Amaia Salvador, Michal Drozdzal, Xavier Giro-i Nieto e ´ Adriana Romero. Cottura inversa: generazione di ricette da immagini di cibo. In Atti della conferenza IEEE/CVF sulla visione artificiale e il riconoscimento dei modelli, pagine 10453–10462, 2019.

(8) Junnan Li, Dongxu Li, Caiming Xiong e Steven Hoi. Blip: bootstrap della pre-formazione del linguaggio e dell’immagine per la comprensione e la generazione unificate di visione e linguaggio. In Conferenza internazionale sull’apprendimento automatico, pagine 12888–12900. PMLR, 2022.

(9) Alexey Dosovitskiy, Lucas Beyer, Alexander Kolesnikov, Dirk Weissenborn, Xiaohua Zhai, Thomas Unterthiner, Mostafa Dehghani, Matthias Minderer, Georg Heigold, Sylvain Gelly et al. Un’immagine vale 16×16 parole: trasformatori per il riconoscimento delle immagini su larga scala. prestampa di arXiv arXiv:2010.11929, 2020.

(10) Prateek Chhikara, Ujjwal Pasupulety, John Marshall, Dhiraj Chaurasia e Shweta Kumari. Sistema di risposta alle domande rispettoso della privacy per la valutazione online del rischio per la salute mentale. In The 22nd Workshop on Biomedical Natural Language Processing and BioNLP Shared Tasks, pagine 215–222, Toronto, Canada, luglio 2023. Association for Computational Linguistics.

(11) Colin Raffel, Noam Shazeer, Adam Roberts, Katherine Lee, Sharan Narang, Michael Matena, Yanqi Zhou, Wei Li e Peter J Liu. Esplorare i limiti del trasferimento di apprendimento con un trasformatore da testo a testo unificato. The Journal of Machine Learning Research, 21(1):5485–5551, 2020.

(12) Chunting Zhou, Graham Neubig, Jiatao Gu, Mona Diab, Francisco Guzman, Luke Zettlemoyer e Marjan ´ Ghazvininejad. Rilevamento del contenuto allucinatorio nella generazione di sequenze neurali condizionali. In Findings of the Association for Computational Linguistics: ACL-IJCNLP 2021, pagine 1393–1404, 2021.

(13) Mehrdad Farahani e Kartik Godawat e Haswanth Aekula e Deepak Pandian e Nicholas Broad. Chef trasformatore. https://huggingface.co/flax-community/t5- generazione di ricette. Accesso effettuato il 12 aprile 2023.

(14) Aman Madaan, Shuyan Zhou, Uri Alon, Yiming Yang e Graham Neubig. I modelli linguistici del codice consentono di apprendere con poco senso comune. Nei risultati dell’Associazione per la linguistica computazionale: EMNLP 2022, 2022

Fonte: towardsdatascience.com