Quando le persone parlano di intelligenza artificiale, di solito si concentrano su ciò che produce: testo simile a quello umano, immagini straordinarie o consigli stranamente accurati. Ciò che raramente attira l’attenzione è il modo in cui l’intelligenza artificiale comprende qualcosa in primo luogo. Questa comprensione inizia con i codificatori. Pensa a un codificatore come a un traduttore che converte informazioni disordinate del mondo reale in un linguaggio strutturato con cui le macchine possono lavorare.

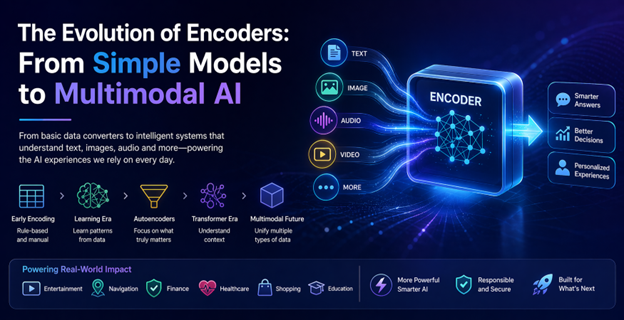

Nel corso del tempo, i codificatori si sono evoluti silenziosamente da semplici convertitori di dati a sistemi sofisticati in grado di comprendere più forme di informazioni contemporaneamente. Questa trasformazione non è avvenuta da un giorno all’altro. È una storia di progressi graduali, sfide pratiche e scoperte guidate da esigenze del mondo reale.

L’inizio: quando la codifica era solo un passaggio tecnico

Agli albori dell’apprendimento automatico, la codifica era più una necessità tecnica che un processo intelligente. Gli sviluppatori dovevano decidere manualmente come rappresentare i dati. Se un sistema avesse bisogno di comprendere categorie come “piccolo”, “medio” e “grande”, tali etichette dovevano essere convertite in numeri.

Ha funzionato, ma solo fino a un certo punto. Il sistema non ha capito veramente nulla; ha semplicemente elaborato i numeri. Ad esempio, un primo negozio online potrebbe consigliare prodotti in base a categorie di base, ma non è in grado di cogliere le relazioni sottili. A qualcuno che acquista scarpe da corsa non verrebbero necessariamente mostrati orologi da fitness o attrezzature per l’idratazione a meno che tali collegamenti non fossero esplicitamente programmati.

In breve, i primi codificatori gestivano i dati, non il significato.

Imparare invece di sentirsi dire

Tutto ha iniziato a cambiare quando le reti neurali sono entrate in scena. Invece di affidarsi interamente alle istruzioni umane, i sistemi hanno iniziato ad apprendere modelli direttamente dai dati. Codificatori sono diventati più che semplici convertitori, sono diventati studenti.

Prendiamo il riconoscimento delle immagini come esempio reale. Invece di dire a un sistema cosa definisce le orecchie e i baffi di un gatto, gli sviluppatori della coda potrebbero addestrarlo su migliaia di immagini. Il codificatore capirebbe gradualmente i modelli da solo. Questo cambiamento ha reso l’intelligenza artificiale molto più adattabile e precisa.

La stessa idea si applicava al linguaggio. Le parole non erano simboli; sono diventati rappresentazioni matematiche vettoriali che catturano significato e relazioni. Ecco perché i moderni motori di ricerca capiscono che “voli economici” e “biglietto aereo economico” sono strettamente correlati, anche se la formulazione è diversa.

Codificatori automatici: trovare ciò che conta davvero

Un grande passo avanti è avvenuto con l’introduzione degli autoencoder. Questi modelli sono stati progettati con un’idea semplice ma potente: comprimere i dati e poi ricostruirli. Per riuscirci, il codificatore doveva identificare ciò che contava veramente e ignorare tutto il resto.

Questo approccio si è rivelato incredibilmente utile negli scenari del mondo reale. Nel settore bancario, ad esempio, gli autocodificatori vengono utilizzati per rilevare le frodi. Imparando quale sia il comportamento “normale”, possono individuare rapidamente transazioni insolite. Se qualcuno effettua improvvisamente un acquisto di alto valore in un altro Paese, il sistema lo segnala non perché gli è stato detto di farlo, ma perché ha appreso che il comportamento è insolito.

Un altro esempio quotidiano è l’archiviazione delle foto. Quando carichi immagini su una piattaforma, i codificatori aiutano a ridurre le dimensioni del file mantenendo intatti i dettagli importanti. Ecco perché le immagini si caricano rapidamente senza sembrare eccessivamente compresse.

L’era dei trasformatori: il contesto cambia tutto

Il vero punto di svolta nell’evoluzione degli encoder è arrivato con i modelli di trasformatori. Ciò che li rendeva diversi era la loro capacità di comprendere il contesto. Invece di elaborare le informazioni passo dopo passo, esaminano tutto in una volta e decidono ciò che conta di più.

Ciò è particolarmente importante nel linguaggio. Considera la frase: “Ha visto l’uomo con il telescopio”. Chi ha il telescopio? I modelli precedenti potrebbero lottare con questa ambiguità. I codificatori basati su trasformatore, tuttavia, analizzano l’intera frase e forniscono un’interpretazione più informata.

Questa innovazione è alla base di molti strumenti che le persone utilizzano quotidianamente. Quando interagisci con un chatbot, detta un messaggio o traduci testo online, i codificatori del trasformatore funzionano in background. Rendono queste interazioni naturali, non meccaniche.

Encoder nella vita di tutti i giorni

Oggi gli encoder sono ovunque, anche se la maggior parte delle persone non se ne rende conto. Modellano il modo in cui interagiamo con la tecnologia in modi sottili ma potenti.

Le piattaforme di streaming utilizzano codificatori per comprendere le abitudini di visualizzazione. Se guardi documentari polizieschi e thriller psicologici, il sistema non si limita a classificare il tuo interesse, ma apprende schemi e suggerisce contenuti che si avvicinano sempre di più ai tuoi gusti nel tempo.

Le app di navigazione si basano su codificatori per elaborare i dati sul traffico, le condizioni stradali e il comportamento degli utenti. È così che possono suggerire percorsi più veloci, a volte anche prima che la congestione diventi evidente.

Nel settore sanitario, i codificatori assistono i medici analizzando le immagini mediche. Non sostituiscono il giudizio umano, ma possono evidenziare aree problematiche, aiutando i professionisti a prendere decisioni più rapide e accurate.

Codificatori multimodali: comprendere più di un tipo di dati

L’ultima evoluzione degli encoder è forse la più entusiasmante: la capacità multimodale. Invece di lavorare con un solo tipo di dati, questi codificatori possono elaborare testo, immagini e altro allo stesso tempo.

Questo apre le porte a esperienze che sembrano molto più naturali. Immagina di scattare una foto di una pianta e chiedere al tuo telefono come prendertene cura. Un codificatore multimodale può analizzare l’immagine, comprendere la tua domanda e fornire una risposta utile in pochi secondi.

Lo shopping online è un’altra area in rapido miglioramento. Invece di digitare una descrizione, gli utenti possono caricare un’immagine di un prodotto che preferiscono. Il sistema trova quindi elementi simili, combinando il riconoscimento visivo con la comprensione contestuale.

Questa capacità di connettere diversi tipi di informazioni sta avvicinando l’intelligenza artificiale al modo in cui gli esseri umani sperimentano il mondo.

Sfide che derivano dal progresso

Man mano che gli encoder diventano più potenti, diventano anche più esigenti. I modelli avanzati richiedono risorse informatiche, che possono essere costose e ad alta intensità energetica. Ciò solleva importanti questioni sulla sostenibilità e sull’accessibilità.

I pregiudizi sono un’altra preoccupazione. Poiché i codificatori imparano dai dati, possono riflettere le disuguaglianze esistenti. Ad esempio, se un sistema è addestrato su dati di assunzione distorti, potrebbe involontariamente favorire determinati gruppi rispetto ad altri. Affrontare questo problema richiede un’attenta selezione dei dati e una supervisione continua.

C’è anche la questione della privacy. I codificatori spesso elaborano informazioni personali, rendendo la protezione dei dati una priorità importante. Trovare il giusto equilibrio tra innovazione e responsabilità è una sfida continua.

Cosa ci aspetta

Il futuro degli encoder non è tanto una questione di scoperte drammatiche quanto piuttosto un perfezionamento. I ricercatori stanno lavorando per creare modelli più veloci, più efficienti e meno dispendiosi in termini di risorse. Ciò potrebbe rendere gli strumenti avanzati di intelligenza artificiale accessibili alle piccole imprese e agli sviluppatori indipendenti.

La personalizzazione è un’altra area di crescita. I codificatori potrebbero presto adattarsi in tempo reale, imparando dai singoli utenti per offrire esperienze su misura. Nell’istruzione, ad esempio, i sistemi potrebbero adattare i contenuti in base a come uno studente apprende meglio, rendendo le lezioni più efficaci.

Anche i sistemi multimodali continueranno a migliorare, fondendo diversi tipi di dati in modo più fluido. Ciò potrebbe portare a interfacce più intuitive, in cui l’interazione con la tecnologia sembra naturale quanto interagire con un’altra persona.

Conclusione: una rivoluzione silenziosa con un grande impatto

I codificatori potrebbero non essere la parte più visibile dell’intelligenza artificiale, ma sono tra i più importanti. La loro evoluzione da semplici convertitori di dati a sistemi multimodali intelligenti ha rimodellato ciò che le macchine possono fare.

Ciò che rende interessante questo viaggio è quanto rispecchia da vicino le esigenze del mondo reale. Ogni progresso non riguardava solo una tecnologia migliore; si trattava di risolvere problemi pratici, comprendere il linguaggio, riconoscere immagini, individuare frodi e migliorare le esperienze quotidiane.

Mentre l’intelligenza artificiale continua a crescere, i codificatori rimarranno al centro, trasformando silenziosamente le informazioni grezze in informazioni significative. Possono lavorare dietro le quinte, ma il loro impatto è impossibile da ignorare.

Fonte: www.artificialintelligence-news.com