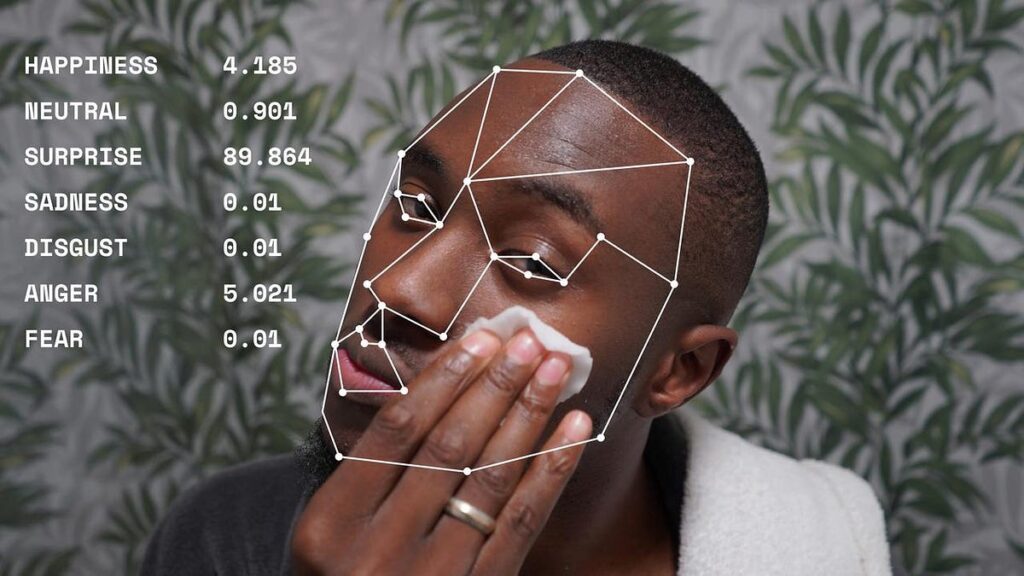

2. Le emozioni come dati (personali)?

Una cosa che può venire in mente quando si pensa alle emozioni dal punto di vista legale, e soprattutto nel contesto dell’intelligenza artificiale, è che si tratta di una sorta di dati. Magari anche dati personali. Dopotutto, cosa può esserci di più personale delle emozioni? Dei tuoi sentimenti che tieni così attentamente per te? Bene, consideriamo brevemente questa ipotesi.

I dati personali ai sensi del GDPR sono definiti come “qualsiasi informazione relativa a una persona fisica identificata o identificabile.Una persona fisica identificabile è quella che può (almeno teoricamente) essere identificata da qualcuno da qualche parte, indipendentemente dal fatto che sia diretta o indiretta. L’aspetto un po’ problematico delle emozioni in questo contesto è che sono universali. Tristezza, felicità, rabbia o eccitazione non mi dicono nulla che possa farmi identificare il soggetto che sta vivendo queste emozioni. Ma questo è un approccio eccessivamente semplicistico.

Prima di tutto, i dati emotivi non esistono mai nel vuoto. Al contrario, ciò si deduce dal trattamento di grandi quantità di dati personali (a volte di più, a volte di meno, ma sempre). Viene dedotto analizzando i nostri dati sanitari come la pressione sanguigna e la frequenza cardiaca, nonché i nostri dati biometrici come i movimenti oculari, le scansioni facciali o le scansioni vocali. E combinando tutti questi vari punti dati utilizzati, è infatti possibile identificare una persona.(3) Anche il GDPR testimonia questo fatto spiegando già nella definizione di dato personale che l’identificazione indiretta può essere ottenuta facendo riferimento a “uno o più fattori specifici dell'identità fisica, fisiologica, genetica, mentale, economica, culturale o sociale di (a) persona fisica.â€(4)

Gli esempi più semplici sono, ovviamente, vari sistemi di riconoscimento delle emozioni nei dispositivi indossabili e personali come quelli di Jane, in cui i dati sono direttamente collegati al suo profilo utente e ai dati dei social media, rendendo l'identificazione molto più semplice. Tuttavia, anche quando non si ha a che fare con dispositivi personali, è comunque possibile identificare indirettamente le persone. Ad esempio, una persona che sta di fronte a un cartellone pubblicitario intelligente e riceve un annuncio basato sul suo stato emotivo combinato con altre caratteristiche evidenti.(5) Perché? Bene, perché l’identificazione è relativa e altamente specifica al contesto. Ad esempio, non è la stessa cosa se dico “Ho visto una ragazza dall'aspetto triste” o se dico “Guarda quella ragazza dall'aspetto triste dall'altra parte della strada”. Restringendo il contesto e il numero di altri possibili individui a cui potrei fare riferimento, l'identificazione diventa una possibilità molto probabile, anche se tutto ciò che ho usato erano informazioni molto generiche.(6)

Inoltre, se qualcuno lo è identificabile dipenderà anche fortemente da cosa intendiamo con quella parola. Vale a dire, potremmo significare identificarsi come “conoscere per nome e/o altri dati del cittadino”. Ciò sarebbe, tuttavia, ridicolo in quanto tali dati sono modificabili, possono essere falsificati e manipolati, per non parlare del fatto che non tutte le persone ne sono in possesso. (Pensate agli immigrati clandestini che spesso non hanno accesso ad alcuna forma di identificazione ufficiale.) Le persone senza documento d'identità per definizione non sono identificabili? Penso di no. Oppure, se lo sono, c’è qualcosa di seriamente sbagliato nel modo in cui pensiamo all’identificazione. Questo sta anche diventando un argomento piuttosto comune per considerare le operazioni di trattamento dei dati rilevanti per il GDPR, con sempre più autori che adottano una nozione ampia di identificazione come “individuazione”(7)'distinzione',(8) e persino il “targeting”.(9) Tutte cose per cui tutti questi sistemi sono stati progettati.

Sembrerebbe quindi che le emozioni e i dati emotivi potrebbero benissimo rientrare nell’ambito di applicazione del GDPR, indipendentemente dal fatto che l’azienda che li elabora li utilizzi anche per identificare una persona. Tuttavia, anche se non lo fossero, i dati utilizzati per dedurre le emozioni saranno sicuramente sempre personali. Ciò a sua volta rende applicabile il GDPR. A questo punto non entriamo nel dettaglio di cosa ciò significhi o di tutti i modi in cui le disposizioni del GDPR vengono violate dalla maggior parte (tutti?) dei fornitori di tecnologie di riconoscimento delle emozioni. Dopotutto sono ancora impegnati a sostenere che i dati emotivi non sono personali.

Fonte: towardsdatascience.com