Le reti neurali a grafo (GNN) e i modelli di linguaggio di grandi dimensioni (LLM) sono emersi come due rami principali dell’intelligenza artificiale, ottenendo un immenso successo nell’apprendimento rispettivamente dai dati strutturati a grafo e dal linguaggio naturale.

Poiché i dati strutturati in grafici e quelli in linguaggio naturale diventano sempre più interconnessi nelle applicazioni del mondo reale, vi è una crescente necessità di sistemi di intelligenza artificiale in grado di eseguire ragionamenti multimodali.

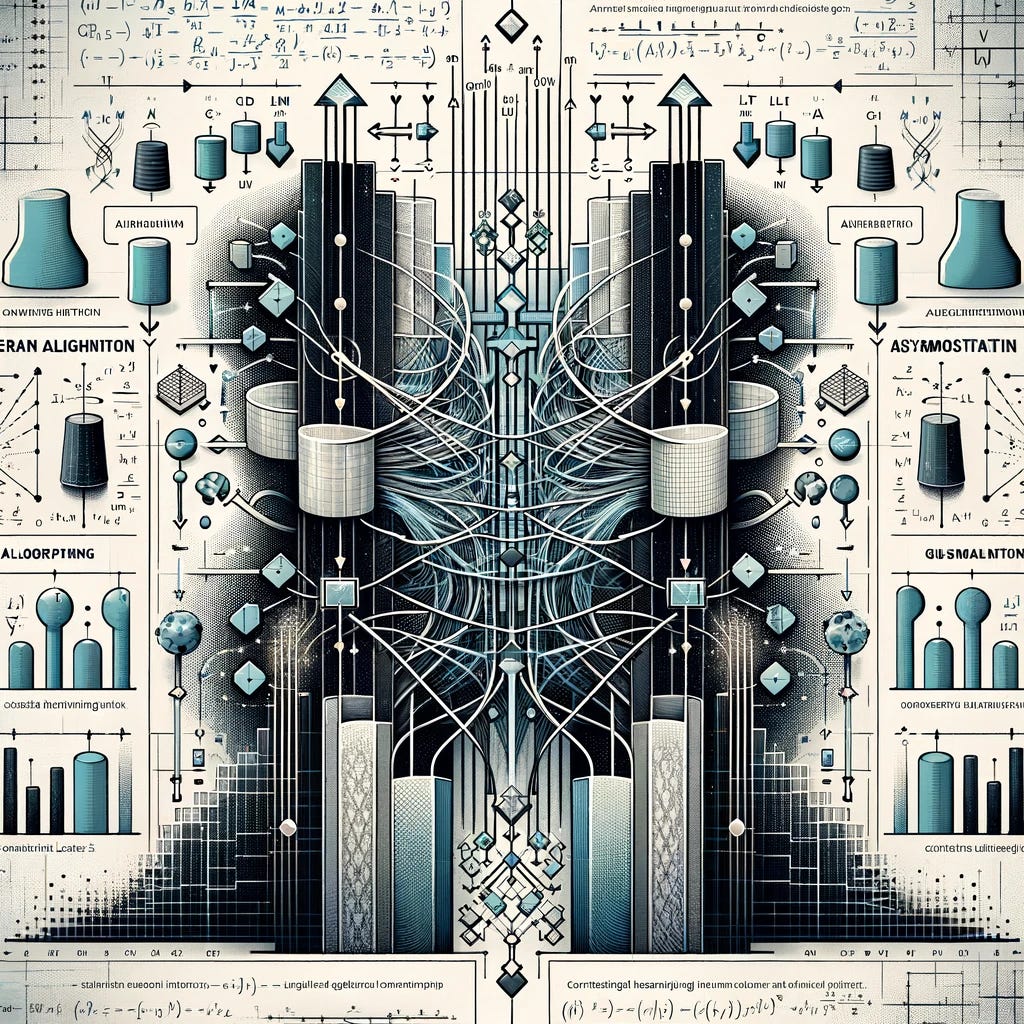

Questo articolo esplora le architetture integrate del linguaggio dei grafi che combinano i punti di forza complementari delle reti neurali dei grafi (GNN) e dei modelli di linguaggio di grandi dimensioni (LLM) per un’analisi avanzata.

Gli scenari del mondo reale spesso coinvolgono dati interconnessi con modalità sia strutturali che testuali. Ciò fa emergere la necessità di architetture integrate in grado di eseguire ragionamenti sfaccettati unificando i punti di forza complementari di GNN e LLM.

Nello specifico, mentre le GNN sfruttano il passaggio dei messaggi sui grafici per aggregare modelli locali, gli incorporamenti dei nodi hanno una capacità limitata di acquisire funzionalità avanzate.

Al contrario, gli LLM mostrano eccezionali capacità di ragionamento semantico ma hanno difficoltà con il ragionamento relazionale sulla topologia strutturata intrinsecamente compresa dai GNN.

La fusione dei due paradigmi consente un’analisi più contestuale e informata.

Recentemente, hanno acquisito importanza le architetture integrate in linguaggio grafico che mettono in sinergia i punti di forza complementari dei codificatori GNN e dei decodificatori LLM.

Come riassunto in un documento di indagine (Li et al. 2023), questi approcci integrati possono essere classificati in base al ruolo svolto dai LLM:

LLM come potenziatore: Gli LLM rafforzano gli incorporamenti dei nodi e le funzionalità testuali per migliorare le prestazioni GNN sui grafici con attributi di testo. Le tecniche applicano miglioramenti basati sulla spiegazione che sfruttano informazioni aggiuntive generate da LLM o miglioramenti basati sull’incorporamento dell’output diretto.

LLM come predittore: Sfrutta le capacità generative degli LLM per fare previsioni sui grafici. Le strategie appiattiscono i grafici in descrizioni di testo sequenziali o utilizzano GNN per…

Fonte: towardsdatascience.com